扩散LLM推理用上类GRPO强化学习!优于单独SFT,UCLA、Meta新框架d1开源

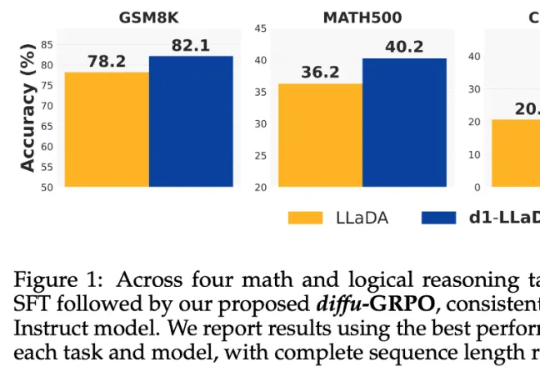

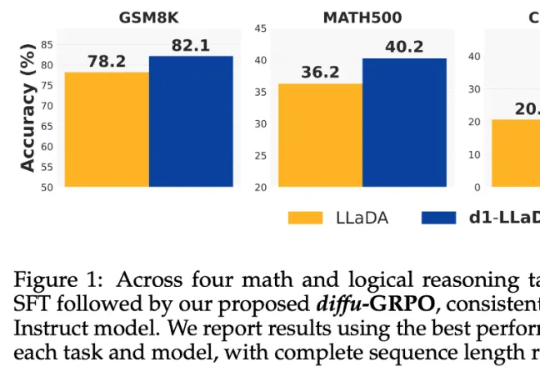

扩散LLM推理用上类GRPO强化学习!优于单独SFT,UCLA、Meta新框架d1开源当前,强化学习(RL)方法在最近模型的推理任务上取得了显著的改进,比如 DeepSeek-R1、Kimi K1.5,显示了将 RL 直接用于基础模型可以取得媲美 OpenAI o1 的性能不过,基于 RL 的后训练进展主要受限于自回归的大语言模型(LLM),它们通过从左到右的序列推理来运行。

当前,强化学习(RL)方法在最近模型的推理任务上取得了显著的改进,比如 DeepSeek-R1、Kimi K1.5,显示了将 RL 直接用于基础模型可以取得媲美 OpenAI o1 的性能不过,基于 RL 的后训练进展主要受限于自回归的大语言模型(LLM),它们通过从左到右的序列推理来运行。

就在昨天,深耕语音、认知智能几十年的科大讯飞,发布了全新升级的讯飞星火推理模型 X1。不仅效果上比肩 DeepSeek-R1,而且我注意到一条官方发布的信息——基于全国产算力训练,在模型参数量比业界同类模型小一个数量级的情况下,整体效果能对标 OpenAI o1 和 DeepSeek R1。

3D生成明星玩家VAST,又又又又又开源了!Tripo Doodle(内部代号TripoSG Scribble) ,能够将简单的2D草图和文本提示(Text Prompt)实时转化为精细的3D模型。它改进了传统3D建模学习曲线陡峭、耗时耗力的痛点,尤其是在初期“打形”阶段。

最近,一位 X 网友向 OpenAI CEO Sam Altman 提问:「我很好奇,人们在和模型互动时频繁说『请』和『谢谢』,到底会让 OpenAI 多花多少钱的电费?」尽管没有精确的统计数据,但 Altman 还是半开玩笑地给出了一个估算——千万美元。他也顺势补了一句,这笔钱到底还是「花得值得」的。

阿拉伯联合酋长国计划利用人工智能,协助起草新法规及审查修订现行法律,这是这个海湾国家在AI上已投入数十亿美元基础上,采取的最激进尝试。人工智能研究人员表示,该国官方媒体所称的“人工智能驱动监管”计划比其他任何地方所见都更为超前,同时指出细节尚不充分。其他政府正尝试运用 AI 提升效率,从法案摘要到优化公共服务,但尚未通过分析政府与法律数据来主动提议修改现行法律。

OpenAI 最近发布了三份针对企业客户的研究报告,本次挑选了其中的「AI in the Enterprise」一篇进行了翻译。

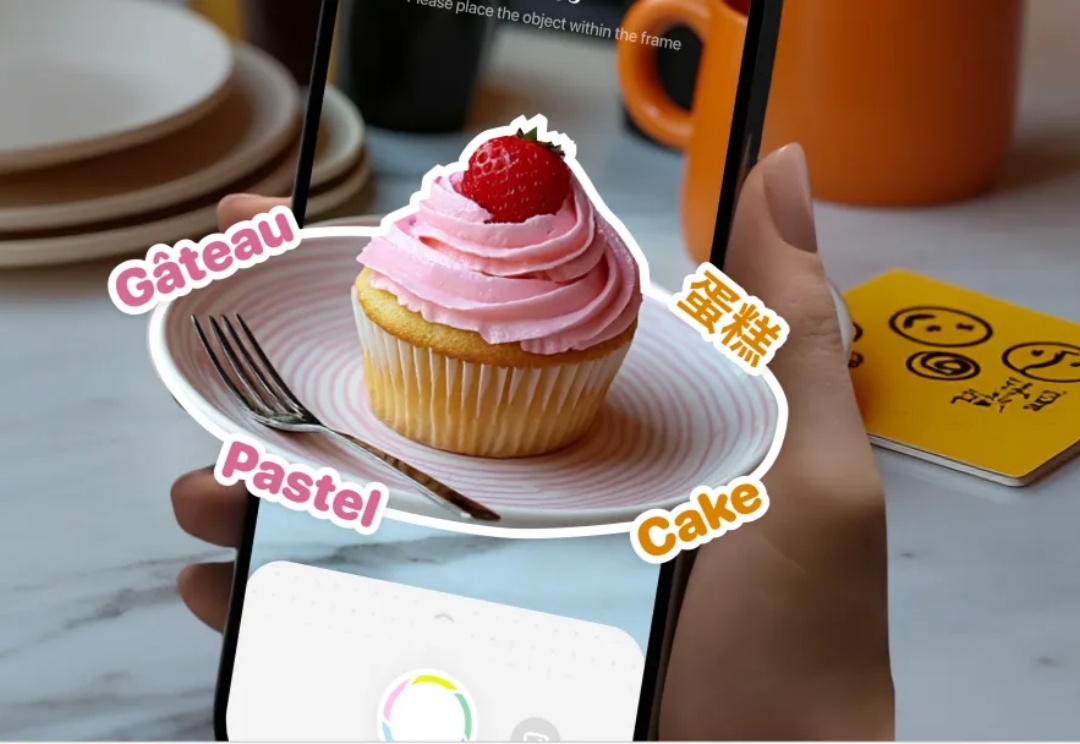

从一句“爸爸,这个怎么说?”开始,一款爆火的外语学习 App 诞生了。

TytoCare是一家开创性的虚拟护理公司,致力于在家中提供便捷、高质量的基础护理。该公司宣布,它已成为全球首个获得美国食品药品监督管理局(FDA)批准用于基于人工智能(AI)检测所有三种主要异常肺部声音的公司。

近期,大模型智能体(Agent)的相关话题爆火 —— 不论是 Anthropic 抢先 MCP 范式的快速普及,还是 OpenAI 推出的 Agents SDK 以及谷歌最新发布的 A2A 协议,都预示了 AI Agent 的巨大潜力。

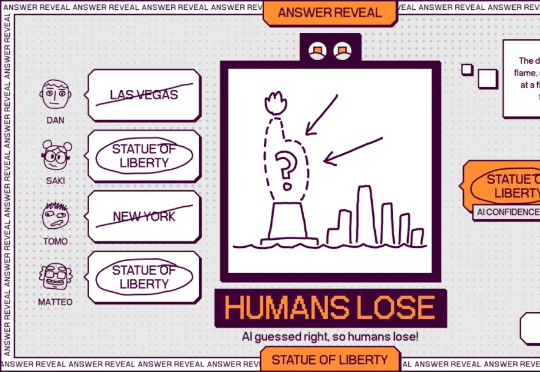

我们体验了 11 款 AI 游戏后,发现不少开发者在玩法设计上进行了有趣的突破。比如一些游戏通过让 AI 与玩家一起玩“你画我猜”,但与常理不同的是AI猜玩家画,让原本简单的游戏变得充满意外和笑点;也有像《萌爪派对》这样的游戏,把 AI 角色当作宠物一样培养,玩家和 AI 互动时,能看到角色“成长”,甚至随着时间的推移产生不同的变化。